Copyright 2018-2025 速推科技 版权所有 京ICP备19012569号-1

坏消息,开源模型和闭源模型的差距越来越大了。

好消息,DeepSeek 又出手了。

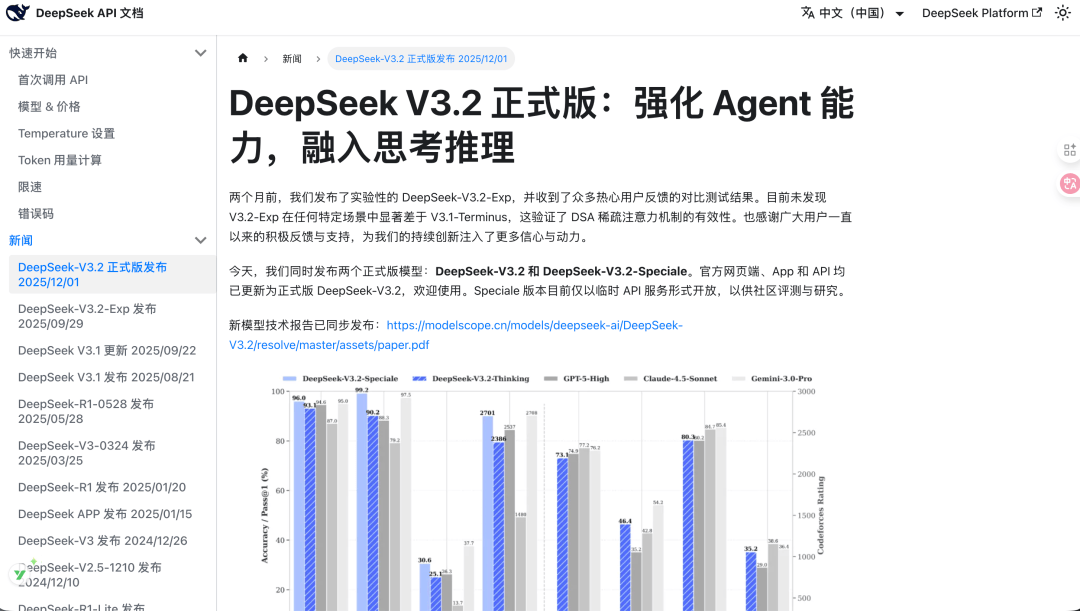

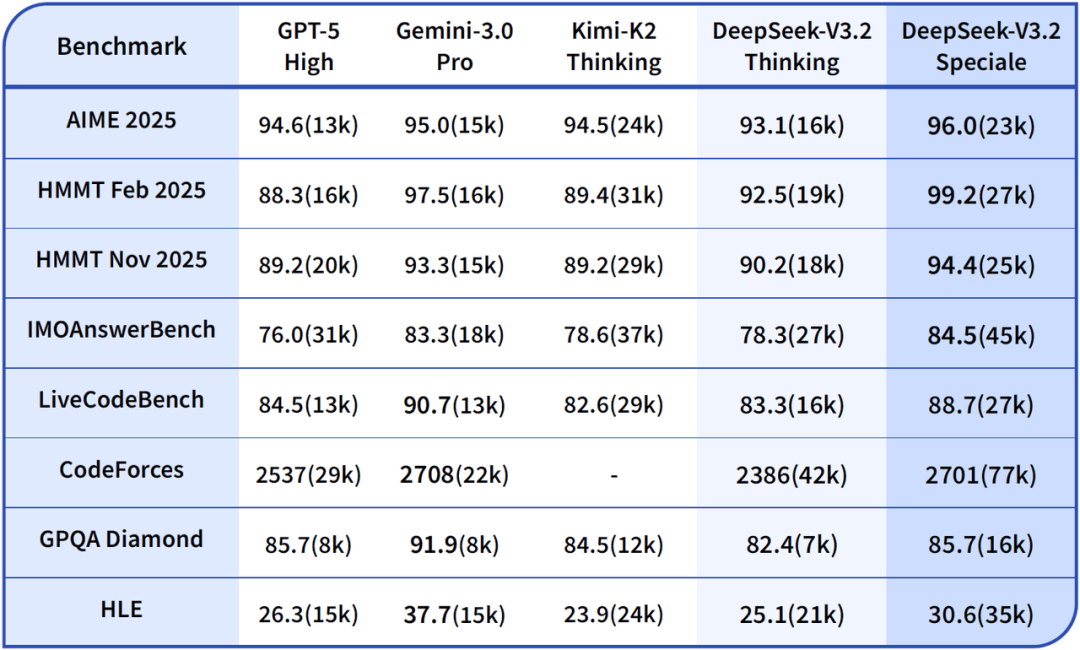

12 月 1 日,DeepSeek 发布了两款新模型 —— DeepSeek V3.2 和 DeepSeek-V3.2-Speciale。

前者和 GPT-5 能打的有来有回,后面的高性能版更是直接把 GPT 爆了,开始和闭源模型天花板 —— Gemini 打了个五五开。

还在IMO 2025(国际数学奥林匹克)、CMO 2025(中国数学奥林匹克)等一系列比赛中拿下金牌。

这是这家公司今年第九次发布模型,虽然大家期待的 R2 还没有来。

所以,DeepSeek 是怎么用更小的数据,更少的显卡,做出能和国际巨头来抗衡的模型?

我们翻开了他们的论文,想把这件事给大家讲清楚。

为了做到这个目标,DeepSeek 又整了不少新招:

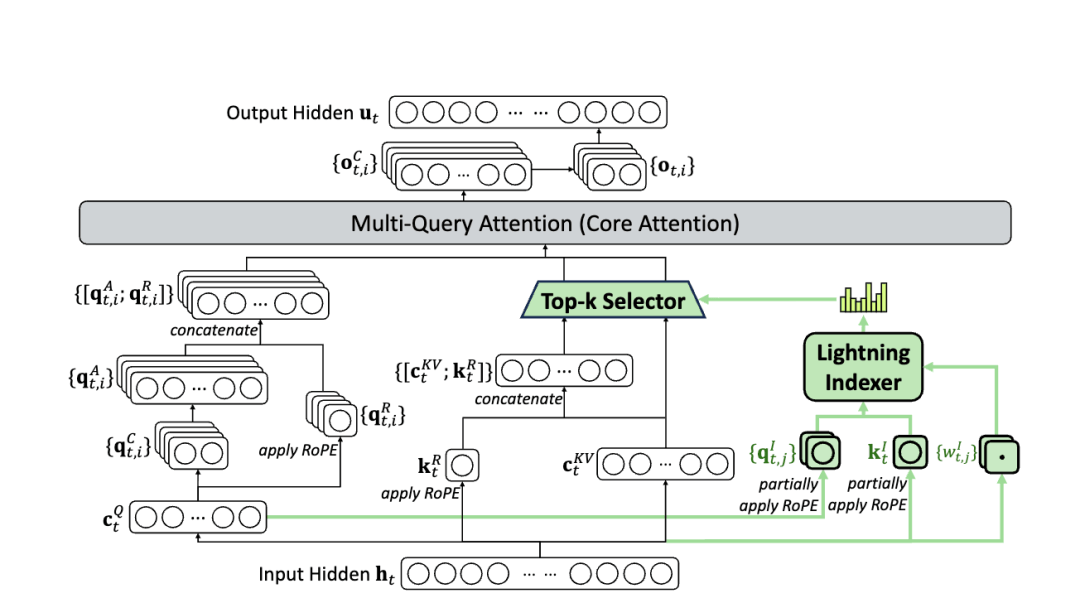

先是把咱们的老朋友 DSA —— 稀疏注意力给转正了。

这东西在之前的 V3.2-EXP 版本里出现过,当时只是测了一下 DSA 会不会影响模型的性能,现在是真的把这玩意给放到了主力模型上。