刚小步快跑了一波GPT 5.1,主打让大模型说人话,OpenAI又在可解释性上做文章了。

真的是paper的那种。

论文公开了OpenAI内部一种训练小模型的新方法,能让模型的内部机制更容易被人类理解,即更具可解释性。

OpenAI自己是这样介绍的:

- ChatGPT背后的语言模型具有复杂且时长令人惊讶的结构,我们尚未完全了解它们是如何工作的。

这种方法有助于我们缩小其中的差距。

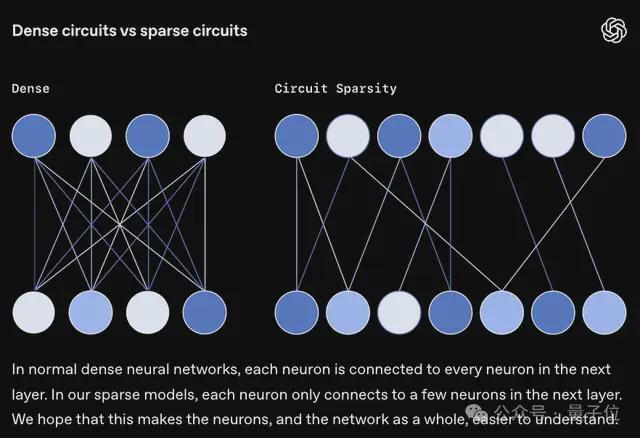

简单来说,在这项研究中,OpenAI研究员们的核心思路是:训练神经元连接少、但神经元数量多的稀疏模型,让神经网络变得简单,也更容易理解。

如果你对模型可解释性感兴趣,这篇论文值得一读。

而对于OpenAI的难得open,还有不少网友关心:那么新的小模型系列要来了吗?

通过稀疏模型理解神经网络

来看具体研究内容。

OpenAI研究员们认为,推理模型通过思维链展现出的可解释性在短期内非常有价值,能让我们捕捉到模型的“欺骗”等行为。但完全依赖这一特性显然不太可靠,随着时间的推移,这种策略也可能会失效。

想要更本质地理解模型机制,还是需要对模型的计算过程进行完全逆向工程。

问题在于,从复杂密集网络入手,难度非常大:每个神经元都与其他数千个神经元相连,不同的神经元又执行着许多不同的功能,这让理解它们看上去几乎不可能。

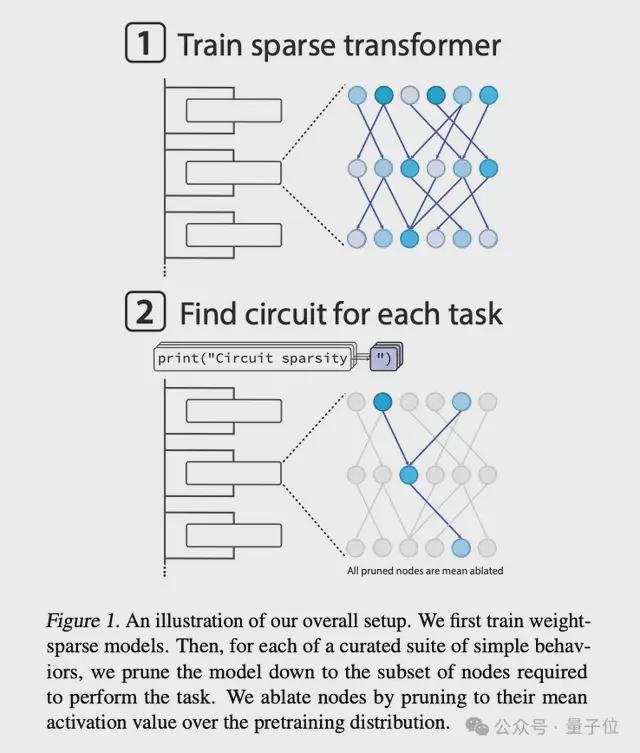

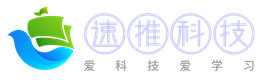

那么,能否训练一个拥有很多神经元,但每个神经元只有几十个连接的模型,来帮助人们理解模型机制呢?

基于这一核心思路,OpenAI的研究人员训练了一个小模型:采用的还是现代语言模型的基础架构(类似GPT-2),只做了一个小小的改动——

强制将模型的大部分权重设为0。

评估可解释性

有了这个稀疏模型,下一步,研究人员的目标是,找出模型在每一项任务中的“回路(circuit)”。